I udstillingen In the Clouds på Horsens Kunstmuseum undersøger den svenske kunstner Arvida Byström komplekse spørgsmål om fake nøgenbilleder genereret af AI- værktøjer. “Det faktum, at ‘afklædningswebsites’ overhovedet eksisterer, er interessant”, mener hun. “Og det er så nyt, at det er svært at vide, om det vil forstærke de stigma, der er bundet til seksuelle nøgenbilleder og til nøgenbilleder i det hele taget.”

Er Arvida Byström (f.1991) billedkunstner, fotograf, performer, model eller internetfænomen? Vel lidt af det hele – og i sandhed synlig på mange platforme, fra Instagram over modeblade til alverdens kunstmuseer.

Lige nu udstiller hun på Horsens Kunstmuseum, og hun har sin trofaste følgesvend, Pedro (en lille hund af racen Brun Griffon), i favnen, da vi mødes på museet. Her bliver han hjemmevant siddende under hele vores samtale.

Allerede som tolvårig var Arvida Byström til stede på de dengang purunge sociale internetplatforme og har siden ikke mindst udforsket selfien som en særlig effektiv billedform, der iværksætter et væld af komplekse spørgsmål omkring identitet, køn og billedkultur.

Gennem årene er hun på mange måder blevet til en slags stedfortræder for nye generationer, der udvikler identitet, udtryk og indflydelse på sociale platforme. Platforme, der som altovervejende karakteristikum har, at de i ekstrem grad er billedbårne.

Hun har været både foran og bag kameraet, været med i kvindelige kunstnerfællesskaber, som ud fra stærke teoretiske parametre har sat spørgsmålstegn ved femininitet og kønsstandarder – ikke mindst ved hjælp af en pink, girly-æstetisk omfavnelse.

Selfie stick Aerobics

Nogle kender hende måske fra den performance, hun skabte med den danske kunstner Maja Malou Lyse, Selfie stick Aerobics, som var en slags tutorial, der skulle lære deltagerne, hvordan man tager bedre selfies ved at acceptere sin krop og skønhed.

Nogle kender hende måske fra den performance, hun skabte med den danske kunstner Maja Malou Lyse, Selfie stick Aerobics, som var en slags tutorial, der skulle lære deltagerne, hvordan man tager bedre selfies ved at acceptere sin krop og skønhed.

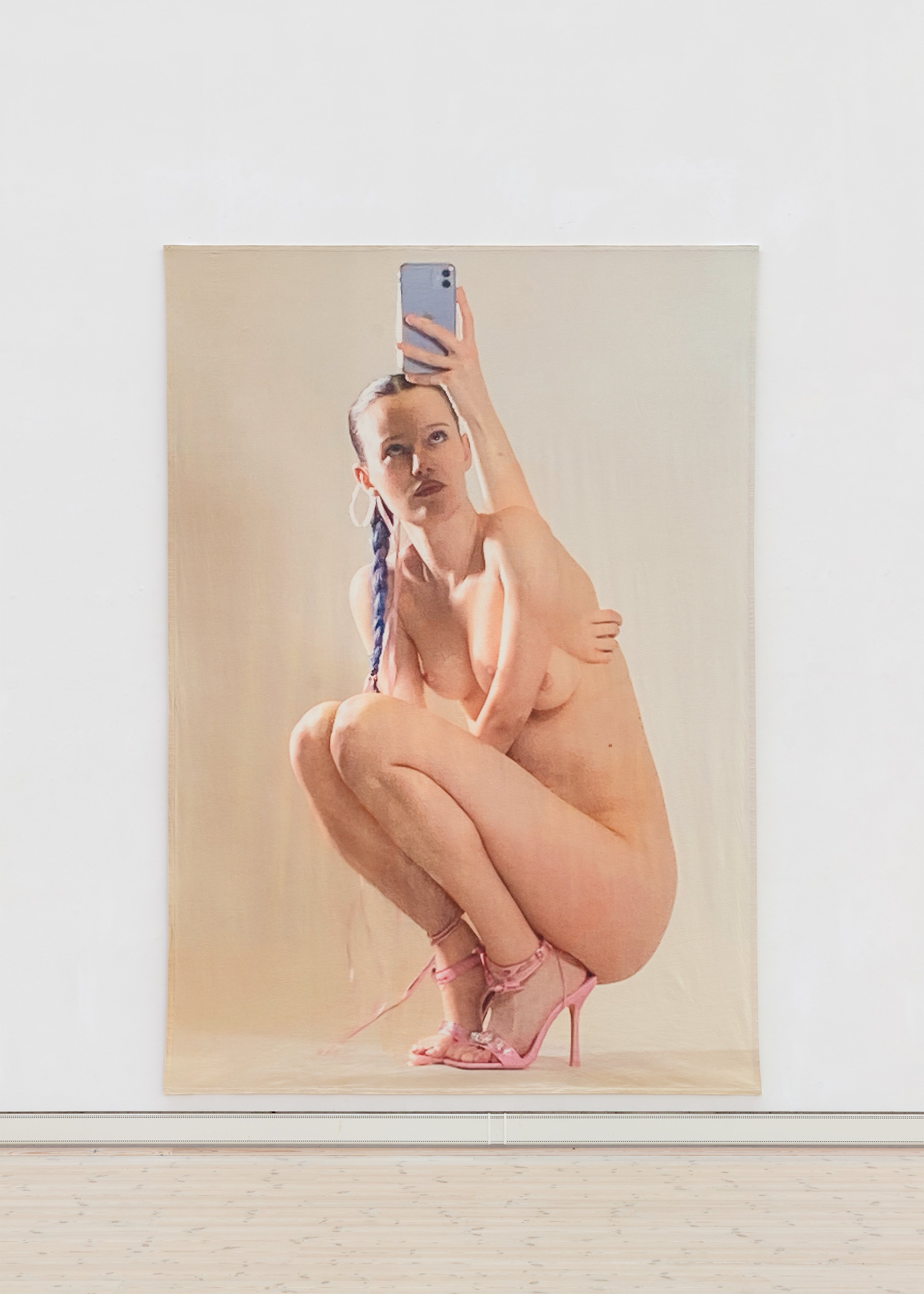

Arvida Byström: Coexist, 2022. Foto: Arvida Byström.

Andre er måske stødt på Arvida Byström på danske udstillingssteder gennem de sidste år, hvor hun i billeder og performances har optrådt i selskab med sin sexdukke Harmony. Med langt lyserødt hår og iklædt matchende undertøj og makeup er grænserne mellem dem slørede, ligesom hendes værker generelt bevæger sig i et felt mellem ‘billede’ og ‘virkelighed’.

Andre igen er måske blandt de knap 200.000 følgere på hendes Instagram-profil, som fungerer som et løbende ‘online-udstillingssted’ i sin egen ret.

Pornografien er ofte en betydelig drivkraft for de nye teknologier.

Arvida Byström

Er AI en kvinde?

Ofte tager Arvida Byströms kunstprojekter afsæt i projekter i ‘skyen’, som det lidt misvisende hedder om de kæmpe maskinparker, der står rundt omkring i verden og processerer enorme datamængder. Det gælder ligeledes for udstillingen i Horsens, der akkurat hedder In the Clouds. Arvida fortæller:

Ofte tager Arvida Byströms kunstprojekter afsæt i projekter i ‘skyen’, som det lidt misvisende hedder om de kæmpe maskinparker, der står rundt omkring i verden og processerer enorme datamængder. Det gælder ligeledes for udstillingen i Horsens, der akkurat hedder In the Clouds. Arvida fortæller:

“Som kunstner er jeg optaget af det feminine og specielt i forhold til teknologi og digitalisering. Det forekommer mig vigtigt, da en stor del af de nye teknologier er baseret på det feminine. Mange AI-teknologier er feminiserede, eksempelvis Siri (red.: stemmeaktiveret assistent for Apple-produkter), ligesom de ganske ofte kan spores tilbage til pornografien, som ofte er en betydelig drivkraft for de nye teknologier.”

Afklædnings-websites

Udstillingen In the Clouds er baseret på ‘resterne’ af et online performanceprojekt, Arvida Byström påbegyndte i slutningen af 2023, hvor hun benyttede en billedmanipulationsapp, Underess Me, der med AI kan fjerne tøjet fra portrætbilleder. Appen bliver mest af alt brugt til at lave falske nøgenbilleder af kvinder uden deres vidende, og med en sådan ny teknologi, hvor alle har adgang til at producere deepfakes, rejser sig et væld af komplekse spørgsmål om misbrug, ufrivillig eksponering og digitale overgreb.

Udstillingen In the Clouds er baseret på ‘resterne’ af et online performanceprojekt, Arvida Byström påbegyndte i slutningen af 2023, hvor hun benyttede en billedmanipulationsapp, Underess Me, der med AI kan fjerne tøjet fra portrætbilleder. Appen bliver mest af alt brugt til at lave falske nøgenbilleder af kvinder uden deres vidende, og med en sådan ny teknologi, hvor alle har adgang til at producere deepfakes, rejser sig et væld af komplekse spørgsmål om misbrug, ufrivillig eksponering og digitale overgreb.

“I stedet for at køre billeder af andre mennesker gennem websidens AI-værktøj, benyttede jeg fotos, jeg har taget af mig selv. I forvejen ligger der mange billeder af mig online, og der er en god chance for, at folk allerede gør det. Nu gjorde jeg det så selv.”

“Samtidig begyndte jeg at sælge billederne på en OnlyFans-lignende website uden at gøre det klart, at der var tale om kunstige, AI-genererede billeder.”

Hun fik desuden lavet et setup, så det var en chatbot, der svarede, når folk ville kommunikere med hende på platformen. Denne AI-sprogmodel var trænet på interviews med hende. Da Arvida offentliggjorde sine arbejdsmetoder, var meningerne delte – nogle så det som bedrag, andre som en sofistikeret kunstnerisk strategi.

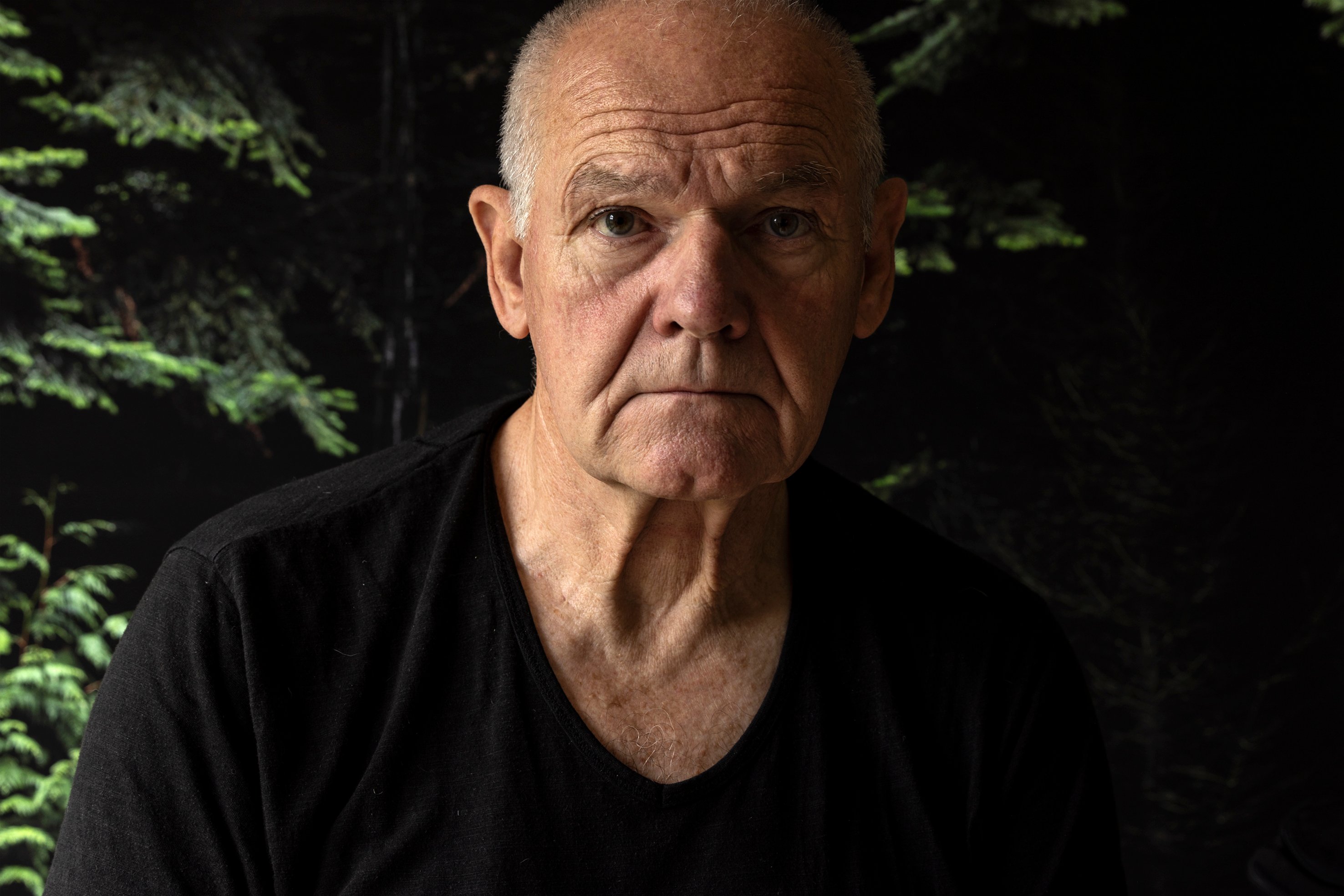

Arvida Byström: Biblically Accurate Babe. Foto: Jacob Friis-Holm Nielsen.

I udstillingen i Horsens kan man opleve hologramprojektionen Biblically Accurate Babe, som er del af en installation med kirkebænke og et lydværk, der blandt andet udforsker forbindelser mellem AI og skabelsesberetningen. Projektionen viser Arvida Byström som en vægtløs engel i flydende overgange fra påklædt til nøgen, nøjagtig som når et billede bearbejdes på en af disse ‘afklædnings’-platforme.

Photoshoppede, sexy billeder

Men hvad synes hun selv om de billeder, programmet genererede?

Men hvad synes hun selv om de billeder, programmet genererede?

"Jeg synes, de kom til at fremstå som meget photoshoppede, sexy billeder, og det er for eksempel interessant, at de billeder, der kom ud af det, konstant gjorde mine bryster meget større – sikkert fordi programmet er trænet med en masse pornografiske billeder.”

“Det er også interessant, at billederne – i samme nu, de blev kørt igennem denne pornografiske æstetik – blev til ‘lavkulturelle billeder’ og fik en kodning af at være mindre æstetiske. For mig siger det noget om, hvor mange bias og unfair ideer vi har om kvinders kroppe.”

Det store problem er, at nøgenbilleder af kvinder er så stigmatiserede.

Arvida Byström

“Jeg synes, det store problem er, at nøgenbilleder af kvinder er så stigmatiserede, at de – uanset om de er fake eller ej – vejer så tungt, at de kan bruges som en trussel.”

“Det faktum, at sådanne ‘afklædningswebsites’ overhovedet eksisterer, er interessant. Og det er så nyt, at det er svært at vide, om det vil forstærke de stigma, der er bundet til seksuelle nøgenbilleder og til nøgenbilleder i det hele taget.”

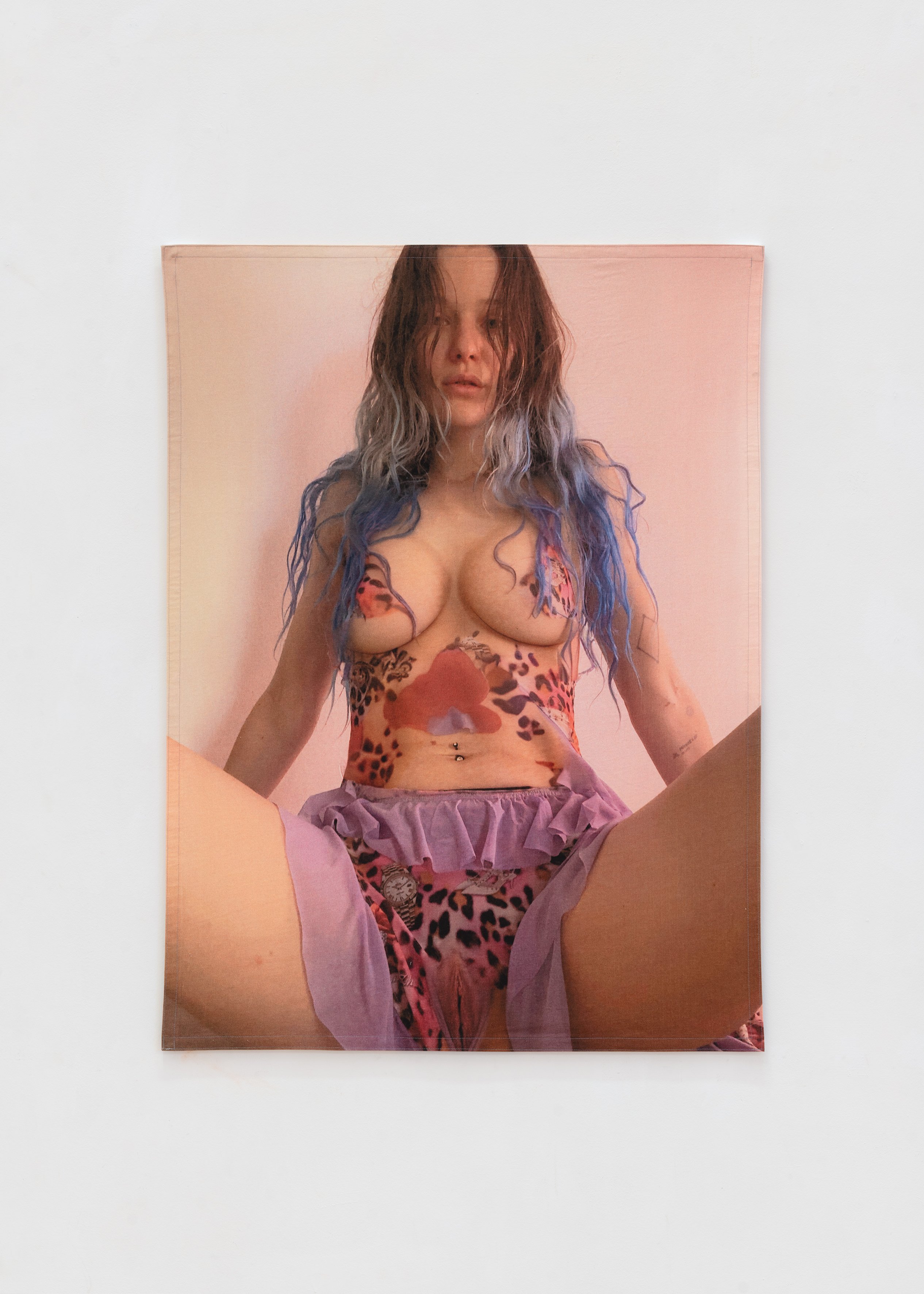

Arvida Byström: Fra serien In the Clouds. Foto: Jacob Friis-Holm Nielsen.

Arvida Byström: Fra serien In the Clouds. Foto: Jacob Friis-Holm Nielsen.

Skal vi byde det velkommen?

“Ideer om den ‘virkelige kvinde’ og billeder som disse hvirvler også op i forestillinger om, hvorvidt den kunstige femininitet kan erstatte den virkelige femininitet. Det er kompliceret, men det er noget, som vi måske også skulle byde velkommen?”

“Ideer om den ‘virkelige kvinde’ og billeder som disse hvirvler også op i forestillinger om, hvorvidt den kunstige femininitet kan erstatte den virkelige femininitet. Det er kompliceret, men det er noget, som vi måske også skulle byde velkommen?”

“Køn er helt generelt en social konstruktion. Jo, der er forskelle mellem kønnene, vi har forskellige hormoner og så videre, men i sidste ende er nogle af de ideer, vi har om mænd og kvinder, mere baseret på kulturelle bias og konstruktioner end på faktiske forskelle. På samme måde som ideen om en smuk og perfekt kvinde er konstrueret. Måske vil robotter være i stand til at gøre det bedre end mennesker. Måske vil det frigøre os fra en form for pres.”

Kroppe ser ikke rigtig ud, som de ser ud på billeder.

Arvida Byström

“Vi ville ikke bruge biler, hvis de ikke var hurtigere end os – på samme måde tror jeg, det er med nye teknologier. Først er vi meget bange for dem, men efterhånden accepterer vi dem og undlader at sammenligne os med dem. Jeg tror, det er det samme med kunstig intelligens.”

“Når en teknologi er ny, prøver vi stadig at finde ud af, hvordan vi forholder os til den på en sund måde, ligesom vi også har en tendens til at læse en masse magi ind i teknologien. Lidt som da fotografiet var nyt. Dengang undersøgte vi det som en magisk maskine. I dag synes vi måske nok, at fotografier er seje, men vi synes ikke længere, teknologien er så magisk.”

Arvida Byström: Fra serien In the Clouds. Foto: Jacob Friis-Holm Nielsen.

Kroppen går ikke op

Udover holograminstallationen indeholder udstillingen i Horsens en række store fotos printet på store lærreder – et enkelt af dem er så stort, at det danner en skillevæg i rummet. Her ser man en mærkelig, sammensat krop, hvor der nok er hud, en brystvorte, en navle, noget lyst hår og glat lingeri, men hvor kroppen så at sige ‘ikke går op’.

Udover holograminstallationen indeholder udstillingen i Horsens en række store fotos printet på store lærreder – et enkelt af dem er så stort, at det danner en skillevæg i rummet. Her ser man en mærkelig, sammensat krop, hvor der nok er hud, en brystvorte, en navle, noget lyst hår og glat lingeri, men hvor kroppen så at sige ‘ikke går op’.

Arvida kalder billederne for “rester” fra hendes onlineprojekt:

“Det var ret sjovt for mig at udforske, hvad AI'en ikke kunne lave, og ud fra mine erfaringer med onlineværktøjet virkede det, som om det primært var trænet i mere klassiske seksualiserede positurer set forfra, mens det var virkelig dårligt til at lave numser eller rygge og den slags ting.”

“Når jeg prøvede at lave noget mere mærkeligt, gengav AI’en det ikke særlig godt. Fordi jeg har arbejdet med den hyperfeminine æstetik i lang tid – hvor en del af den også er en pornografisk æstetik – spurgte jeg mig selv, hvordan jeg kunne læne mig op ad æstetikken, mens jeg på en måde brød den op? Det har så skabt nogle billeder af kroppe, der ikke giver mening. Det er jeg fascineret og tiltrukket af.”

Arvida Byström: Fra serien In the Clouds. Foto: Jacob Friis-Holm Nielsen.

Arvida Byström: Fra serien In the Clouds. Foto: Jacob Friis-Holm Nielsen.

Arvida Byström: Fra serien In the Clouds. Foto: Jacob Friis-Holm Nielsen.

Arvida Byström: Fra serien In the Clouds. Foto: Jacob Friis-Holm Nielsen.

Hvordan laver man billeder af seksualitet?

Arvida mener også at billederne handler om at afsløre nogle forestillinger om billedskabelse. At udforske følelser om de komplekse forhold ved at forsøge at repræsentere kroppen og seksualiteten i billeder.

Arvida mener også at billederne handler om at afsløre nogle forestillinger om billedskabelse. At udforske følelser om de komplekse forhold ved at forsøge at repræsentere kroppen og seksualiteten i billeder.

“For kroppe ser ikke rigtig ud, som de ser ud på billeder. Kun i et splitsekund, fordi vi ikke opfatter verden præcis som et kamera.”

“Det er ikke let at lave et billede af seksualitet. Seksualitet er en kompleks størrelse, som rummer en masse følelser og ikke er særlig lineær. Det kan både være meget behageligt og lidt ulækkert, og en del af det skal måske også være ulækkert, for sådan er kroppe.”

“Kroppe er ikke bare denne perfekte, fredfyldte, rene ting. Kroppe er meget mere mærkelige, og fra dag til dag kan vi have meget forskellige følelser i forhold til kroppen. Måske er det det, jeg godt kan lide ved de her billeder,” slutter Arvida.